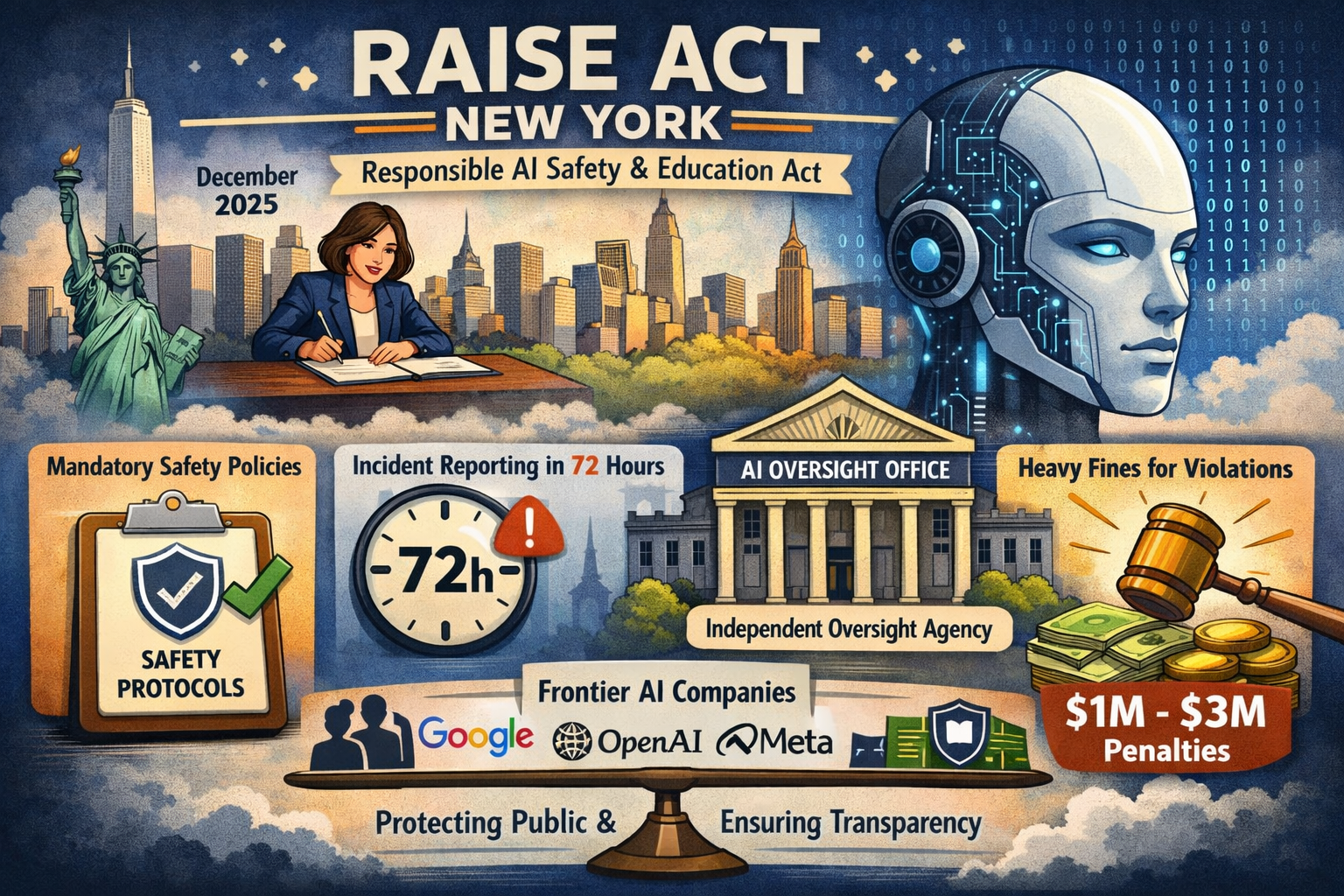

در ۲۰ دسامبر ۲۰۲۵ (حدوداً هفته گذشته)، فرماندار ایالت نیویورک، کتی هوخول (Kathy Hochul) قانونی جدید و بسیار مهم درباره ایمنی و شفافیت هوش مصنوعی را امضا کرد که بهعنوان Responsible AI Safety and Education Act یا رايز اکتی (RAISE Act) شناخته میشود. این قانون یکی از جامعترین قوانین نظارتی AI در آمریکا است و هدف اصلی آن کاهش ریسکهای خطرناک هوش مصنوعی و افزایش شفافیت در توسعه سیستمهای پرقدرت AI اعلام شده است.

📌 اهداف اصلی قانون

قانون RAISE Act با تمرکز بر مدلهای پیشرفته AI طراحی شده و چند هدف کلیدی دارد:

🔹 ۱) الزام به افشای پروتکلهای ایمنی

شرکتهایی که مدلهای بسیار پیشرفته و پرقدرت هوش مصنوعی میسازند، باید برنامهها و چارچوبهای ایمنی و امنیتی خود را تهیه، منتشر و رعایت کنند. این شامل توضیح چگونگی ارزیابی ریسکها و جلوگیری از سوءاستفادههای خطرناک است.

🔹 ۲) گزارشدهی حادثههای ایمنی در ۷۲ ساعت

اگر سیستمهای AI حادثه یا مشکلی که ممکن است به خطرات جدی منجر شود (مثلاً انتشار محتوای مضر، نقص امنیتی یا سوءاستفاده) داشته باشند، شرکتها باید ظرف ۷۲ ساعت آن را اعلام کنند — که این زمان نسبت به سایر قوانین مشابه (مثل کالیفرنیا با ۱۵ روز) بسیار کوتاهتر و سختگیرانهتر است.

🔹 ۳) ایجاد یک دفتر نظارتی مستقل

برای اجرای قوانین، دفتر نظارت بر AI در داخل وزارت خدمات مالی ایالت نیویورک (New York State Department of Financial Services) تشکیل خواهد شد. این دفتر مسئول بررسی گزارشها، صدور قوانین فرعی، منتشر کردن گزارش سالانه و نظارت بر شرکتها است.

🔹 ۴) برخورد با عدم رعایت قوانین

اگر شرکتها گزارشها را ارائه ندهند یا اطلاعات نادرست دهند، قانون جریمههای سنگینی برای آنها در نظر گرفته است:

-

تا ۱ میلیون دلار برای اولین تخلف

-

تا ۳ میلیون دلار برای تخلفات بعدی

این مجازاتها به خاطر افزایش مسئولیتپذیری توسعهدهندگان AI تعیین شدهاند.

🧩 چه شرکتهایی مشمول این قانون هستند؟

قانون RAISE Act بهطور خاص بر مدلهای “جلوهگر” یا Frontier AI تمرکز دارد — بهعبارتی، سیستمهایی که با مقیاس بسیار بزرگ، بودجه بالا و توان پردازشی فوقالعاده زیاد ساخته شدهاند و معمولاً متعلق به شرکتهای فناوری بزرگ (مثل Google، OpenAI، Meta و …) هستند.

📉 رقابت با قوانین فدرال

این قانون در حالی امضا شده که دولت فدرال آمریکا نیز اخیراً اقداماتی برای جلوگیری از دخالت ایالتها در تنظیم AI اتخاذ کرده (از جمله فرمان اجرایی از سوی رئیسجمهور)، ولی نیویورک با این امضا نشان داده که برای حفاظت از مردم و جامعه در برابر خطرات احتمالی AI از تحرک ایالتی عقبنشینی نخواهد کرد.

🧠 اهمیت این قانون برای صنعت AI

📍 نیویورک با تصویب این قانون در کنار کالیفرنیا قرار میگیرد و بهنوعی میتواند استانداردهای عملی و موفق نظارتی را برای سایر ایالتها یا حتی سیاستهای ملی تعیین کند.

📍 این قانون نشاندهنده برخورد جدی قانونگذاران با ریسکهای بالقوه مدلهای هوش مصنوعی است — بهخصوص مواردی که ممکن است به امنیت عمومی، حقوق افراد، یا اختلال در نظامهای حیاتی منجر شود.

📍 همچنین شرکتهای AI اکنون با نتیجهای روشن از انتظارات قانونی روبهرو هستند: توسعه مسئولانه و شفاف هوش مصنوعی دیگر یک انتخاب اخلاقی نیست، بلکه یک الزام قانونی است.